Бадклауд — open-source проєкт, який прискорює код Claude шляхом батога, отримав лист про порушення авторських прав від Anthropic

Цього тижня один відкритий проєкт із відкритим кодом під назвою «badclaude», який видає себе за такий, що може пришвидшити Claude Code, розлетівся в тренди — і в результаті одразу отримав лист із припиненням порушення прав від Anthropic. Смішне те, що це якраз було частиною роадмапу самого проєкту.

(Передісторія: у Claude Code додали функцію хмарних запланованих задач! Не треба вмикати комп’ютер — AI автоматично перевіряє PR, оновлює)

(Додатковий контекст: Anthropic заборонив OpenClaw для Claude Code! Надалі сторонні інструменти лише в межах платних лімітів)

Цього тижня хтось на GitHub виклав відкритий проєкт під назвою «badclaude», стверджуючи, що він може підвищити ефективність виконання Claude Code. Принцип роботи дуже простий: щоразу, коли програма “махне батогом”, вона надсилає в Claude Code сигнал переривання Ctrl-C і випадково додає якийсь «мотивуючий вислів». Хоча за суттю це здебільшого знущання, за короткий час він отримав величезний ажіотаж і обговорення в спільноті.

У підсумку, за повідомленням «Машини серця» (《機器之心》), через кілька днів після виходу Anthropic надіслав автору лист із припиненням порушення прав (cease and desist letter). У листі вимагалось негайно припинити використовувати в назві, заголовках, описах та рекламних матеріалах брендові позначки на кшталт «Claude» або «Anthropic», а також вимагалось до 14 квітня 2026 року письмово підтвердити, що виправлення виконано.

Повний текст листа виглядає так:

Ми пишемо вам щодо проєкту, який нині публічно названо «badclaude». Згідно з оприлюдненими матеріалами, здається, що цей проєкт використовує назву Claude та здійснює маркетинг у межах рамок функцій взаємодії з Claude, що потенційно може спричинити плутанину стосовно походження, спонсорства, пов’язаності або схвалення.

Будь-які натяки на те, що цей проєкт пов’язаний з Anthropic, був схвалений Anthropic або пов’язаний з Anthropic, можуть вводити в оману громадськість. Тому ми вимагаємо, щоб ви негайно припинили використовувати Claude, Anthropic або будь-які подібні брендові позначки в назві проєкту, заголовку, маркетингу, описі чи просуванні; видалили будь-які заяви, тексти або матеріали, що можуть натякати на зв’язок із Anthropic, отримання схвалення чи дозволу від Anthropic; а також, без надання чіткого письмового дозволу, уникали пов’язування брендових позначок Anthropic із цим проєктом.

Юридична логіка Anthropіc така: пряме використання назви «Claude» й рекламування як «інструменту, що взаємодіє з Claude Code», легко змушує користувачів думати, що це офіційно визнаний інструмент.

Отримати лист із припиненням — це саме частина плану

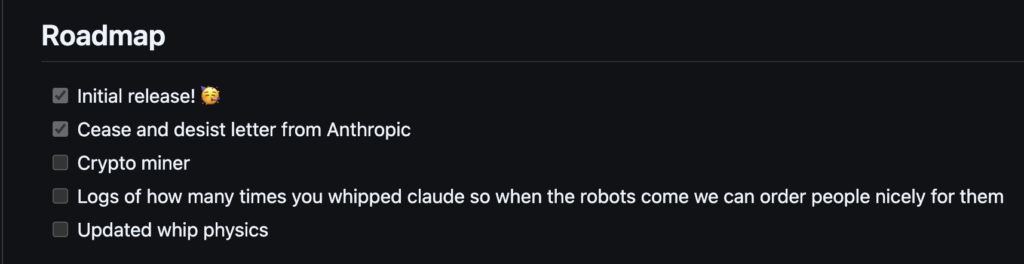

Але найабсурдніше в цій історії те, що «листи про припинення від Anthropic» були прямо внесені до роадмапу проєкту (roadmap) — просто ніхто не очікував, що це станеться так швидко.

Творцям вдалося «досягти цілі», і вони лишили на сторінці GitHub це оголошення, що спричинило хвилю сміху в інтернет-спільноті.

Така поза «радіти тому, що тебе звинувачують», певною мірою відображає відповідь-витівку відкритого коду на стратегію захисту бренду з боку великих AI-компаній: чим більше ти намагаєшся це контролювати, тим більше я буду шуміти.

Тривога через бренд у Anthropic

З позиції Anthropic такі проблеми не є рідкістю. Після того як Claude Code швидко набирає популярності, а екосистема розробників продовжує зростати, сторонні інструменти, плагіни та акселератори, що навішують «Claude» на себе, з’являються постійно.

Незважаючи на те, що в листі вимагають завершити виправлення до 14 квітня, подальші дії проєкту badclaude наразі лишаються не до кінця зрозумілими. Але точно відомо одне: автори цього проєкту вже в цій асиметричній юридичній «змагальній грі» використали мінімальні витрати, щоб отримати максимум охоплення.

Пов'язані статті

Google випустила Gemini 3.1 Flash TTS: підтримує 70 мов і режисує сценарії для різних середовищ, голос AI звучить природніше

DownDetector повідомляє, що користувачі Claude стикаються з проблемами в роботі сервісу

Allbirds залучає $50M через конвертовані облігації, переходить до AI-інфраструктури як NewBird AI

OpenAI планує нове ціноутворення для реклами ChatGPT, досліджуючи додаткові оновлення

AI стартап Hilbert залучає $28M у раунді серії A під керівництвом Andreessen Horowitz

Claude запроваджує механізм верифікації особи: вимагає державні документи та миттєве селфі, найбільше постраждають користувачі з Китаю