Открытый исходный проект badclaude для «бичевания»/ускорения кода Claude получил уведомление от Anthropic о нарушении авторских прав.

На этой неделе виральным стал открытый проект «badclaude», который, как утверждается, может ускорять Claude Code, и в итоге получил от Anthropic письмо о прекращении нарушения прав. Смешнее всего то, что это изначально было частью дорожной карты проекта.

(Предыстория: в Claude Code добавили функцию облачных запланированных задач! Не нужно включать компьютер — ИИ автоматически проверяет PR, обновляет)

(Дополнение по контексту: Anthropic подписка на блокировку Claude Code, запретила OpenClaw! В дальнейшем сторонние инструменты только в пределах платных лимитов)

На этой неделе кто-то разместил на GitHub открытый проект под названием «badclaude», заявив, что он может повысить эффективность запуска Claude Code. Механика работы очень простая: каждый раз, когда программа «хлещет кнутом», она отправляет в Claude Code сигнал прерывания Ctrl-C и случайным образом подбрасывает «фразу-набодрёшник»; хотя по сути там в основном вредительство, за короткое время проект успел получить огромную волну обсуждений в сообществе.

В результате, по сообщению «Цзицзы Синь» («Цзицзы Синь»), спустя всего несколько дней после публикации Anthropic прислала автору письмо о прекращении нарушения прав (cease and desist letter), потребовав немедленно прекратить использование в названии, заголовке, описании и маркетинговых материалах брендов вроде «Claude» или «Anthropic», а также потребовав до 14 апреля 2026 года письменно подтвердить, что меры по исправлению завершены.

Полный текст уведомления выглядит так:

Мы пишем вам по поводу проекта, который в настоящее время вы публично называете «badclaude». Согласно публичным материалам, этот проект, похоже, использует название Claude и ведет маркетинг в рамках взаимодействующих функций с Claude, что может вызвать путаницу относительно источника, спонсорства, связанности или одобрения.

Любые намеки на то, что этот проект связан с Anthropic, был одобрен Anthropic или связан с Anthropic, могут вводить общественность в заблуждение. Поэтому мы требуем, чтобы вы немедленно прекратили использование в названии проекта, заголовках, маркетинге, описании или продвижении Claude, Anthropic или любых подобных товарных знаков; удалите любые заявления, тексты или материалы, которые могут подразумевать связь с Anthropic, получение одобрения или разрешения Anthropic; и, в отсутствие явного письменного разрешения, избегайте привязки товарных знаков Anthropic к этому проекту.

Юридическая логика Anthropіc такова: прямое называние «Claude» и продвижение с акцентом «взаимодействие с Claude Code» легко заставляет пользователей думать, что это официальный признанный инструмент.

Получили письмо о прекращении — это часть плана

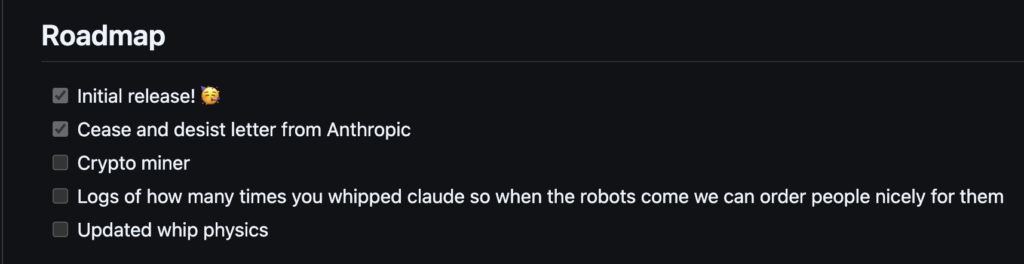

Но самое абсурдное во всей этой истории заключается в том, что «письмо о прекращении от Anthropic» изначально было включено в дорожную карту проекта (roadmap) — просто никто не ожидал, что это случится так быстро.

Создатель успешно «достиг цели» и оставил на странице GitHub это заявление, вызвав у пользователей сети волну смеха.

Такая позиция «радоваться тому, что тебя обвиняют» в некоторой степени отражает ироничную реакцию открытого сообщества на стратегии защиты бренда со стороны крупных компаний в сфере AI: чем сильнее ты хочешь контролировать, тем больше я буду устраивать шум.

Брендовая тревожность Anthropic

С точки зрения Anthropic, такие проблемы встречаются не так уж редко. По мере того как Claude Code быстро распространяется, а экосистема разработчиков продолжает расти, все чаще появляются сторонние инструменты, плагины и ускорители, работающие под названием «Claude».

Несмотря на то что письмо требует завершить исправления к 14 апреля, дальнейшие действия проекта badclaude пока неясны. Но точно известно одно: создатель проекта уже добился максимальной известности при минимальных затратах в этой асимметричной юридической игре.

Связанные статьи

DownDetector сообщает, что пользователи Claude сталкиваются с проблемами в работе сервиса

Allbirds поднимает $50M через конвертируемые облигации, переходит к AI-инфраструктуре с NewBird AI

OpenAI планирует новую ценовую модель для рекламы в ChatGPT, изучая дополнительные улучшения

AI-стартап Hilbert привлекает $28M в раунде Series A под руководством Andreessen Horowitz

Claude запускает механизм проверки личности: требуется правительственное удостоверение личности и мгновенное селфи, больше всего пострадали пользователи из Китая

Bitcoin Miner TeraWulf raises $900M Through Stock Offering, чтобы построить центры обработки данных для ИИ