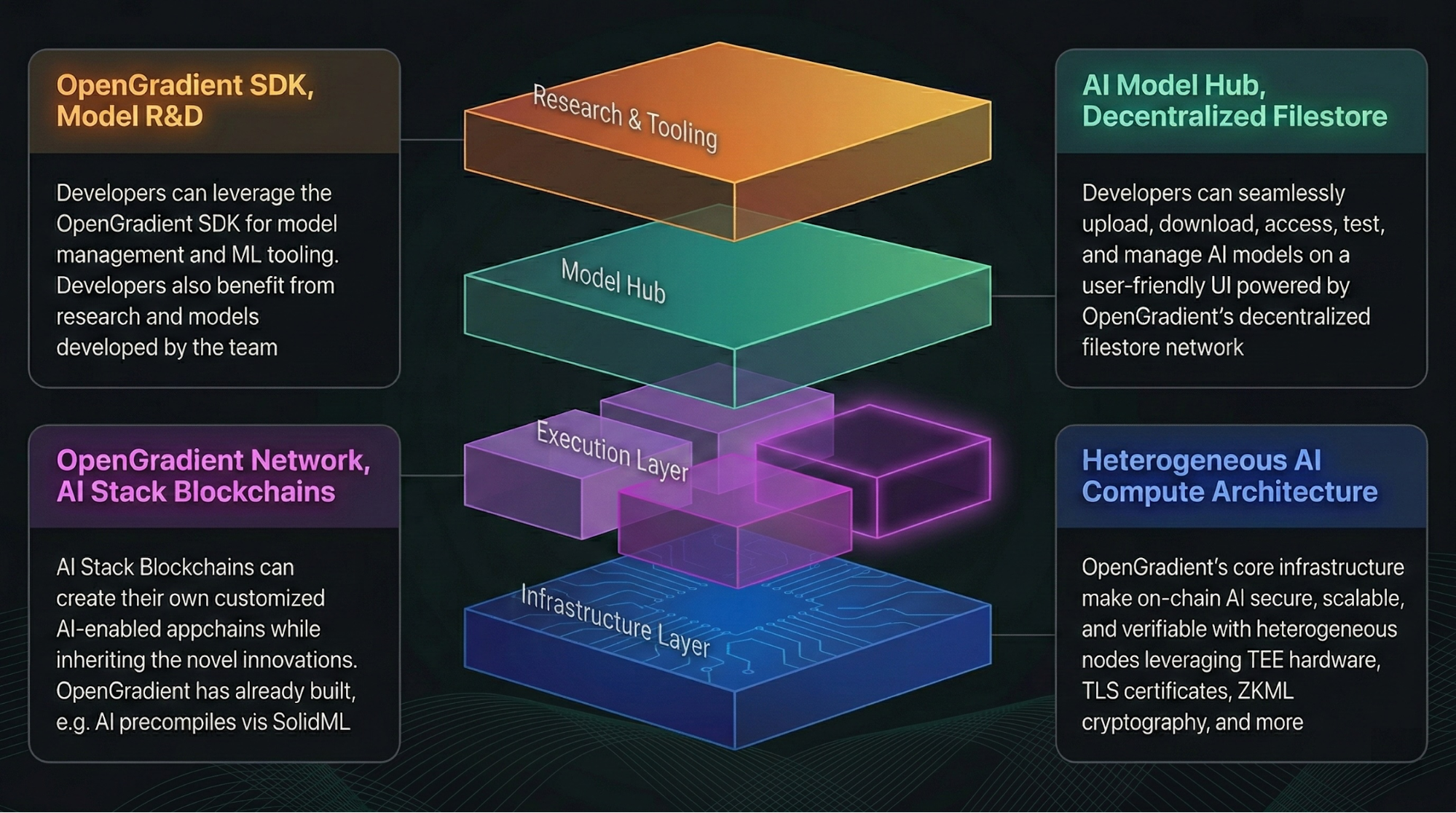

Como o OpenGradient funciona? Um detalhamento do fluxo de trabalho, da solicitação de IA à verificação on-chain

Na prática, quando um desenvolvedor ou usuário envia uma solicitação de IA, ele não recebe um resultado não verificável de forma direta. Em vez disso, o processo segue um fluxo de trabalho em múltiplas etapas — computação, verificação e registro — projetado para garantir resultados confiáveis. Essa estrutura é especialmente fundamental para decisões automatizadas e processamento de dados.

Esse fluxo normalmente envolve entrada de solicitação, execução de inferência, verificação de resultados e confirmação on-chain. A interação desses módulos compõe a lógica operacional da OpenGradient.

Como usuários se conectam à rede OpenGradient

O acesso do usuário inicia todo o fluxo de trabalho.

Tecnicamente, desenvolvedores conectam suas aplicações à rede OpenGradient por meio de uma API ou SDK, enviando solicitações de inferência com parâmetros de modelo e dados de entrada. Ao receber a solicitação, o sistema a formata e prepara para distribuição.

Estruturalmente, a camada de acesso está na borda da rede, convertendo solicitações do usuário em tarefas internas executáveis e encaminhando-as para o sistema de agendamento. Essa camada geralmente inclui serviços de interface e módulos de gerenciamento de solicitações.

Esse design abstrai a complexidade da computação distribuída atrás de uma interface única, permitindo que usuários aproveitem a rede sem precisar entender sua arquitetura interna.

Como solicitações de IA são enviadas no OpenGradient

A etapa de envio determina como as tarefas entram na linha de execução.

Assim que uma solicitação é recebida, o sistema a atribui ao nó de inferência adequado, considerando tipo de tarefa, complexidade e status do nó. Algoritmos de agendamento otimizam o uso dos recursos nesse processo.

O módulo de gerenciamento de solicitações registra detalhes da tarefa e gera um identificador único para acompanhamento e verificação. A tarefa então entra na fila de execução, aguardando processamento pelo nó de inferência.

Esse mecanismo permite agendamento unificado para alocação eficiente de recursos e evita congestionamento de nós.

Como nós de inferência executam computação de modelo

Nós de inferência são responsáveis por realizar os cálculos.

Ao receber uma tarefa, o nó de inferência executa o modelo de IA localmente, processa os dados de entrada e gera resultados. Para garantir verificabilidade, o nó também produz dados de prova relacionados.

Nós de inferência incluem o ambiente de execução do modelo e um módulo de geração de resultados, operando normalmente em ambiente controlado para garantir estabilidade e reprodutibilidade.

Essa etapa assegura que cálculo e geração de provas aconteçam juntos, preparando a base para verificação posterior.

Como nós de verificação validam resultados de inferência

Nós de verificação garantem a integridade e confiabilidade dos resultados.

Eles recebem resultados e dados de prova dos nós de inferência e verificam a correção de forma independente, usando algoritmos de computação ou validação. Caso a validação falhe, o resultado é rejeitado ou recalculado.

A camada de verificação opera independentemente da camada de execução, assim a verificação não depende dos nós originais — aumentando a segurança geral do sistema.

Esse mecanismo transfere a confiança de um único nó para toda a rede, oferecendo resistência a adulteração.

Como o registro on-chain garante confirmação final

O registro on-chain ancora permanentemente o resultado final.

Após a verificação, os resultados são enviados para o blockchain (ou camada de dados relacionada), criando prova imutável de execução. Normalmente, isso envolve etapas de empacotamento e confirmação de dados.

A camada on-chain está no fim do processo, registrando resultados no ledger distribuído para rastreabilidade de longo prazo.

Esse design garante que resultados computacionais sejam persistentes e auditáveis para consultas e revisões futuras.

Como módulos colaboram para completar a execução

A colaboração entre módulos define a eficiência do sistema.

As camadas de solicitação, execução, verificação e registro são conectadas por passagem de mensagens e agendamento de tarefas, com cada fase repassando resultados para a próxima.

Os módulos são organizados em pipeline, permitindo processamento contínuo de tarefas sem gargalos.

| Módulo | Função | Posição |

|---|---|---|

| Camada de acesso | Recebe solicitações | Ponto de entrada |

| Camada de agendamento | Aloca tarefas | Meio |

| Nó de inferência | Executa computação | Núcleo |

| Nó de verificação | Valida resultados | Camada de segurança |

| Camada on-chain | Registra resultados | Ponto final |

Essa abordagem colaborativa aumenta o throughput e assegura responsabilidades claras em cada etapa.

Estrutura do fluxo de inferência do OpenGradient

Todo o fluxo pode ser dividido em etapas sequenciais.

Uma tarefa típica segue a sequência: envio de solicitação → alocação de tarefa → execução de modelo → geração de resultado → verificação → registro on-chain. Essas etapas formam um ciclo fechado.

Cada fase é gerida por um módulo distinto, permitindo responsabilidades claras e escalabilidade do sistema.

Dividir o processo em etapas padronizadas melhora a manutenção e amplia as capacidades do sistema.

Resumo

OpenGradient possibilita computação verificável ao dividir inferência de IA, verificação de resultados e registro on-chain em módulos colaborativos. Essa estrutura permite que redes de IA descentralizadas alcancem eficiência e confiança.

FAQ

Como o OpenGradient processa solicitações de IA?

Após o usuário enviar uma solicitação, o sistema a direciona para nós de inferência para execução e inicia a verificação.

Por que nós de verificação são necessários?

Eles validam resultados de inferência de forma independente, eliminando a dependência de qualquer nó único.

Qual o papel do registro on-chain?

Preservar o resultado final, garantindo imutabilidade e auditabilidade.

Qual a diferença entre nós de inferência e nós de verificação?

Nós de inferência realizam cálculos; nós de verificação confirmam a precisão dos resultados.

Por que o OpenGradient utiliza um fluxo de trabalho em múltiplas etapas?

Um processo por etapas aumenta a eficiência e reforça a segurança, permitindo que cada módulo foque em tarefas especializadas.

Artigos Relacionados

Morpho vs Aave: Análise comparativa dos mecanismos e diferenças estruturais nos protocolos de empréstimo DeFi

0x Protocol vs Uniswap: quais são as diferenças entre os protocolos de livro de ordens e o modelo AMM?

Tokenomics da Morpho: utilidade do MORPHO, distribuição e proposta de valor

Quais são os componentes essenciais do 0x Protocol? Uma visão detalhada da arquitetura de Relayer, Mesh e API

Quais são os casos de uso do token ST? Um olhar aprofundado sobre o mecanismo de incentivo do ecossistema Sentio