随着 AI 与区块链融合加速,去中心化 AI 逐渐形成两种不同发展路径。一种是围绕 AI 模型本身构建协作网络,另一种是构建支撑 AI 应用运行的底层基础设施。

Bittensor 和 0G 正是这两种路径的代表。Bittensor 更关注如何让全球 AI 模型通过激励机制协同工作,而 0G 则关注如何为 AI 应用提供高性能、可扩展的运行环境。这种方向差异,也决定了两者在生态中的不同角色。

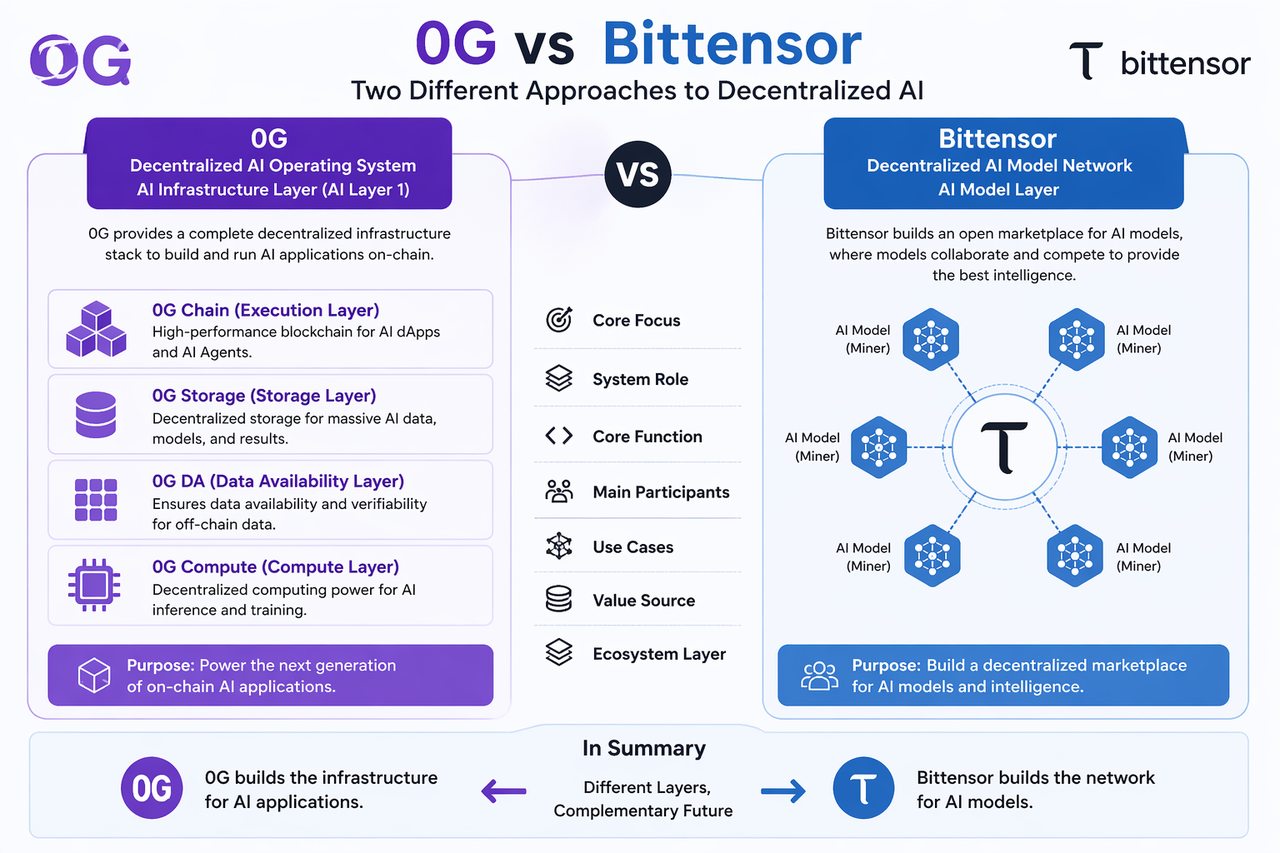

0G 与 Bittensor 在 AI 赛道中的位置

0G 与 Bittensor 分别代表了 AI 生态的两个不同层级。

0G 更偏向底层基础设施(AI Infrastructure Layer),为 AI 应用提供运行环境,包括计算、存储与数据可用性支持。它的目标是成为 AI Layer1,使 AI Agents 能够在链上高效运行。

Bittensor 则更偏向上层网络协议,通过激励机制连接 AI 模型提供者与验证者,构建一个去中心化的 AI 模型市场。

换句话说,一个负责“运行 AI”,另一个负责“连接 AI”。

核心对比:0G vs Bittensor

从系统架构来看,两者的核心差异可以从基础设施层级来理解。

| 对比维度 | 0G | Bittensor |

|---|---|---|

| 核心定位 | 去中心化 AI 基础设施(AI Layer1) | 去中心化 AI 模型网络 |

| 主要目标 | 为 AI dApps 与 AI Agents 提供运行环境 | 构建开放的 AI 模型协作与激励网络 |

| 系统角色 | AI 应用基础设施层 | AI 模型与推理网络层 |

| 技术架构 | 模块化:Chain、Storage、DA、Compute | 子网(Subnet)驱动的机器学习网络 |

| 核心能力 | 执行、存储、数据可用性、去中心化计算 | AI 模型训练、推理与贡献激励 |

| 面向对象 | AI 开发者与应用构建者 | AI 模型提供者与研究者 |

| 应用场景 | AI Agents、链上AI应用、AI dApps | 去中心化推理服务、模型市场 |

| 价值来源 | 基础设施使用与AI应用运行需求 | 模型贡献与推理质量奖励 |

| 生态层级 | AI 基础设施层(Infra Layer) | AI 模型网络层(Model Layer) |

| 关系定位 | AI 应用底层支撑 | AI 智能能力供给网络 |

0G 是模块化 AI Layer1 网络,其核心包括 Chain 执行层、Storage 存储层、DA 数据可用性层以及 Compute 计算层,重点在于支撑 AI Workload(AI 计算负载)。

Bittensor 则构建在激励机制之上,核心是 Subnet 网络结构,用于协调不同 AI 模型之间的贡献与奖励分配,更接近“AI 模型经济系统”。

0G:AI Layer1 基础设施网络

0G 的设计目标是构建一个完整的 AI Infrastructure Stack,使 AI 应用可以直接在链上运行。

它通过四层架构支持 AI Agents 与链上 AI 应用,包括:

执行层负责逻辑运行,存储层负责数据持久化,DA 层负责数据验证,而 Compute 层提供去中心化算力。

因此,0G 更像是一个“AI 运行系统”,强调计算能力与基础设施完整性。

Bittensor:去中心化 AI 模型网络

Bittensor 的核心目标是构建一个开放的 AI 模型网络,通过激励机制促进模型之间的竞争与协作。

在该系统中,不同模型作为节点参与网络,并通过贡献质量获得奖励。这种结构更接近 AI 模型市场(AI Model Marketplace),而非基础设施层。

因此,Bittensor 更关注“AI 智能的生产与分发”,而不是“AI 的运行环境”。

0G vs Bittensor 应用场景差异

0G 更适用于需要高计算与高存储支持的链上 AI 应用,例如 AI Agents、自主执行系统以及复杂推理任务。

Bittensor 更适用于 AI 模型训练、模型共享与分布式智能协作场景,例如模型市场、推理服务网络等。

两者在应用层面并不直接竞争,而是处于 AI stack 的不同层级。

0G vs Bittensor 生态角色对比

在去中心化 AI 生态中,Bittensor 主要承担模型层角色,负责提供智能能力来源。而 0G 则承担基础设施角色,负责提供计算、存储与执行环境。

随着 AI 生态逐渐成熟,这两类系统可能会形成互补关系:模型网络提供智能能力,基础设施提供运行环境,从而共同支撑更复杂的 AI 应用生态。

总结

0G 与 Bittensor 分别代表了去中心化 AI 发展的两条不同路径。Bittensor 聚焦 AI 模型网络,通过激励机制构建开放式机器学习市场;而 0G 则专注 AI 基础设施,为 AI 应用提供完整的链上运行环境。

两者并不处于同一竞争维度,而是分别位于 AI 生态的不同层级。未来随着 AI 应用规模扩大,模型网络与基础设施可能形成更紧密的协作关系,共同推动去中心化 AI 生态的发展。

FAQs

0G 和 Bittensor 的最大区别是什么?

0G 是 AI 基础设施 Layer1,提供计算与存储能力;Bittensor 是 AI 模型网络,负责模型协作与激励分配。

0G 属于哪一层 AI 架构?

0G 属于 AI Infrastructure Layer,专注于链上 AI 运行环境与计算基础设施。

Bittensor 的核心机制是什么?

Bittensor 通过激励机制连接 AI 模型节点,使模型在网络中竞争并获得奖励。

0G 和 Bittensor 可以协同吗?

可以,它们分别处于 AI stack 的不同层级,一个提供基础设施,一个提供模型网络。

哪个更偏基础设施?

0G 更偏基础设施(AI Layer1),而 Bittensor 更偏应用网络(AI Model Layer)。

相关文章

不可不知的比特币减半及其重要性

如何选择比特币钱包?

CKB:闪电网络促新局,落地场景需发力

Master Protocol:激活 BTC 生息潜力